Programm DIGIMET 2017

Quellen und Methoden der Geschichtswissenschaft im digitalen Zeitalter

Neue Zugänge für eine etablierte Disziplin?

DIGIMET 2017

25./26. September 2017, Berlin

Veranstalter: Leibniz-Wettbewerbsprojekt „Welt der Kinder“ (koordiniert am GEI Braunschweig); Deutsches Historisches Institut Washington, DC (DHIW); Verband der Historiker und Historikerinnen Deutschlands (VHD); Facharbeitsgruppe Geschichte in CLARIN-D; AG „Digitale Geschichtswissenschaft“ im VHD

Ort: Humboldt-Universität, Friedrichstraße 191-193, Seminarraum 5009, Berlin

Das Projekt „Welt der Kinder. Weltwissen und Weltdeutung in Schul- und Kinderbüchern zwischen 1850 und 1918“ evaluierte in den letzten Jahren digitale Werkzeuge für ihren Nutzen mit Blick auf geschichtswissenschaftliche Fragestellungen. Zum Abschluss organisiert das Projekt in Kooperation mit Vertretern sowohl der digitalen wie der klassischen Geschichtswissenschaften eine Tagung, die über das Projekt hinausreicht und Grundfragen methodenbewusster historischer Forschung adressiert. Führende Vertreter des Faches diskutierten gemeinsam mit jüngeren Historiker/innen Nutzen, Grenzen und Implikationen digitaler Werkzeuge und Methoden für die Geschichtswissenschaft, in der die Diskussion um große Datenmengen und der Umgang mit Methoden und Theorien aus verschiedenen disziplinären Kontexten eine lange Tradition hat. Gegenwärtig jedoch evoziert die fortschreitende Digitalisierung und die Etablierung von Digital Humanities an vielen Universitäten des In- und Auslandes Fragen und Herausforderungen, die für das Fach neu sind, die nach neuen Arbeitsweisen verlangen und Historiker/innen fordern, den Methodenkanon ihres Faches kritisch zu reflektieren und ggf. zu erweitern.

Ziel der Veranstaltung ist es, damit verbundene Chancen, Probleme und Herausforderungen für die Weiterentwicklung der historischen Geisteswissenschaften zu erörtern und insbesondere die Fragen zu adressieren, wie und warum sich der „Werkzeugkasten“ der Geschichtswissenschaft im Zeitalter der Digitalität verändert hat bzw. verändern sollte. Hierbei werden in einzelnen Sektionen verschiedene Anwendungsbereiche sowie die aktuellen und zukünftigen Rahmenbedingungen diskutiert:

In fünf thematischen Feldern wird ein intensiver Austausch zu diesen Grundfragen der Disziplin stattfinden. Im Zentrum stehen: Digitalen Quellen bzw. Werkzeuge und die Notwendigkeit der Erweiterung der historischen Quellenkritik, Herausforderungen von Born Digital Sources, neue Forschungsstrukturen, Arbeitsweisen und Herausforderungen der Interdisziplinarität, Aufbau und Sicherung fachbezogener digitaler Forschungsinfrastrukturen, Finanzierung und rechtliche Bedingungen einer Digitalen Geschichtswissenschaft sowie Lehre und Ausbildung der Geschichtswissenschaft im digitalen Zeitalter.

Die Konferenz schließt ab mit einer Podiumsdiskussion. Die Teilnehmer werden die Ergebnisse der Konferenz auch international rahmen und gegenwärtige Herausforderungen der digitalen Geschichtswissenschaften in Deutschland im Kontext neuerer Entwicklungen in anderen europäischen Ländern (Österreich, Schweiz) und Nordamerikas auf dem Podium wie auch mit dem Publikum diskutieren.

Teilnehmer/innen, die keinen eigenen Vortrag halten, sind herzlich willkommen. Aus organisatorischen Gründen bitten wir diese um eine Anmeldung bis 01.09.2017. Bitte nutzen Sie hierfür die folgende Emailadresse: info [at] historikerverband [dot] de. Teilnehmergebühren werden nicht erhoben, Kosten für die Anreise können aus organisatorischen Gründen nur für in die Konferenz eingebundene Personen übernommen werden.

Programm

Montag, 25. September 2017 |

12:00 Registrierung

12:45 Begrüßungen und Einführung in die Tagung

Prof. Dr. Simone Lässig (Washington, DC) – Leiterin des Leibniz-Wettbewerbsprojekts „Welt der Kinder“ und Sprecherin der CLARIN F-AG Geschichte

13:30

Panel 1: Digitale Quellen, digitale Werkzeuge und die Notwendigkeit der Erweiterung der historischen Quellenkritik.

Moderation: Andreas Weiß (GEI Braunschweig)

Wenn Quellen zu Daten werden. Zur notwendigen Digitalisierung der Historischen Hilfswissenschaften und deren Konsequenzen Torsten Hiltmann (Universität Münster)

Digitale Wissensrepräsentation in der Provenienzforschung. Zur Online-Dokumentation und -Präsentation von Forschungsdaten zu NS-verfolgungsbedingten Kulturgutverlusten Michael Müller (Freie Universität Berlin)

Digitale Kommunikationsgeschichte – Kommunikationsgeschichte des Digitalen. Gegenstände, Herausforderungen und Potentiale historischer Kommunikationsforschung im digitalen Zeitalter Erik Koenen (Universität Bremen); Christian Schwarzenegger (Universität Augsburg)

Berichterstatter: Maik Fiedler (GEI Braunschweig)

15:00 Pause

15:30

Panel 2: „Digital Born Sources“ als Herausforderung für die Zeitgeschichte

Moderation: Nora Hilgert (VHD Frankfurt/Main)

Archivierung und Erschließung von BLOGs mit dem Werkzeug „TopicExplorer“. Die Debatte über japanische Geschichtslehrbücher unter der Regierung Abe (2012-) als Anwendungsbeispiel Christian Oberländer, Alexander Hinneburg (Universität Halle-Wittenberg)

Archivierung und historische Analyse von Social Media – Das Beispiel Usenet Oliver Kiechle (Universität Düsseldorf)

Wissen vernetzt und visuell gestalten: E-publishing als mediale Erweiterung des geschichtswissenschaftlichen Knowledge Designs Christian Wachter (Universität Göttingen)

Berichterstatter: Katrin Moeller (Universität Halle, AG DGW)

17:00 Pause

18:00 Abendvortrag: Prof. Dr. Rüdiger Hohls (Humboldt-Universität Berlin)

Dienstag, 26. September 2017 |

9:00

Panel 3: Lehre und Ausbildung der Geschichtswissenschaft im digitalen Zeitalter

Moderation: Ernesto de Luca (GEI Braunschweig)

Eine Generation von ›digital natives‹? Doktorierende der Geschichte heute vor der Herausforderung digitaler Methoden Roberto Sala (Universität Basel)

GIS und Geschichte Osteuropas – ein Arbeitsbericht Agnieszka Zagnczyk-Neufeld (Universität Bochum)

E-Learning als innovativer Zugang in die digitale Zukunft der Wissenschaft – Das Projekt WAD Tobias Dewes; Lena Knops (RWTH Aachen)

Berichterstatter: Claudia Prinz (Humboldt-Universität Berlin)

10:30 Pause

10:45

Panel 4: Digitale Infrastrukturen, Finanzierung und rechtliche Bedingungen

Moderation: Thomas Meyer (Berlin, AG DGW)

Datenautorenschaft als Voraussetzung nachhaltigen Forschungsdatenmanagements Katrin Moeller (Universität Halle)

„Geburtsfehlern“ durch Forschungsdatenmanagement vorbeugen!? Anleitung für die Entwicklung eines digitalen Forschungskonzeptes in den Geschichtswissenschaften Marina Lemaire (Universität Trier)

Digitale Archive und die Darstellung des Sammlungszusammenhangs Katharina Hering (Georgetown Law Library Washington)

Berichterstatter: Christian Wachter (Universität Göttingen, CLARIN-D)

12:15 Mittagspause

13:30

Panel 5: Neue Arbeitsweisen und die Herausforderungen der Interdisziplinarität

Moderation: Christa Womser-Hacker (Universität Hildesheim)

Der Aufbau projektunabhängiger historisch-geographischer Informationssysteme: Teamarbeit von Historikern, Kartographen und Informatikern Yvonne Rommelfanger (Universität Trier)

Die Evolution eines Wissenssystems: Vom Repositorium zur Netzwerkanalyse Matteo Valleriani, Ester Chen (MPIWG Berlin)

Arbeit mit Unsicherheit: Automatisches Erkennen von Texten, Entitäten und Strukturen Tobias Hodel (Universität Zürich)

Biographien erfassen und analysieren mit „CosmoTool“ Anna Aschauer (IEG Mainz)

Berichterstatter: Andreas Weiß (GEI Braunschweig)

15:15 Pause

15:45 Abschlussdiskussion: Nora Hilgert (Frankfurt/Main); Rüdiger Hohls (Berlin); Simone Lässig (Washington); Jan Hodel (Basel); Georg Vogeler (Graz) und Berichterstatter

17:00 Ende der Tagung

Call for Papers: DIGIMET 2017

Call for Papers:

Quellen und Methoden der Geschichtswissenschaft im digitalen Zeitalter

Neue Zugänge für eine etablierte Disziplin?

DIGIMET 2017

25./26. September 2017

Berlin

In der Geschichtswissenschaft hat die Diskussion um große Datenmengen und der Umgang mit Methoden und Theorien aus verschiedenen disziplinären Kontexten eine lange Tradition. Dennoch scheint die fortschreitende Digitalisierung Fragen und Herausforderungen zu evozieren, die für das Fach neu sind, die nach neuen Arbeitsweisen verlangen und Historiker/innen fordern, den Methodenkanon ihres Faches zu erweitern.

Zum Ende des Projekts „Welt der Kinder. Weltwissen und Weltdeutung in Schul- und Kinderbüchern zwischen 1850 und 1918“ wollen die Projektpartner aus der Geschichts- und Literaturwissenschaft, der Informationswissenschaft und der Informatik gemeinsam mit dem Deutschen Historikerverband (VHD), dem DHI Washington DC, der CLARIN-D Fach-Arbeitsgruppe Geschichte und weiteren historisch arbeitenden oder mit Historiker/innen kooperierenden Fachgemeinschaften den aktuellen Stand der digitalen Geschichtswissenschaften diskutieren. Ziel der Veranstaltung ist es, Chancen, Probleme und Herausforderungen für die Weiterentwicklung digitaler historischer Geisteswissenschaften zu erörtern und insbesondere die Fragen zu adressieren, wie und warum sich der „Werkzeugkasten“ der Geschichtswissenschaft im Zeitalter der Digitalität verändert hat bzw. verändern sollte.

Die Tagung wird sich auf fünf Themenkomplexe konzentrieren:

1. Digitale Quellen, digitale Werkzeuge und die Notwendigkeit der Erweiterung der historischen Quellenkritik. Hier soll es unter anderem um die Frage gehen, welche Implikationen digitale Quellenkorpora (und deren Entwicklung) und Techniken digitaler Editionen für das Methodenarsenal der historischen Forschung haben. Außerdem soll in einer Art Zwischenbilanz diskutiert werden, wo und wie in digitalen Projekten signifikante Ergebnisse erzielt bzw. neue historische Erkenntnisse gewonnen wurden, in welchem Verhältnis Aufwand und Ertrag stehen und und wie Historiker/innen mit dem methodischen Eklektizismus umgehen (sollten), der sich zwangsläufig einstellt, wenn sie mit heterogenen – digitalen und analogen – Quellen arbeiten.

2. „Digital Born Sources“ als Herausforderung für die Zeitgeschichte. Social Media und insbesondere die gewachsene Bedeutung von Twitter- und Blogposts als Medien des zunehmend auch wissenschaftlichen Austausches stehen für die schnellen Veränderungen im „digitalen Zeitalter“ und für ganz neue Ordnungen des Wissens. Sie bieten Historiker/innen Massenquellen von Subjekten, die sich in klassischen Archivsystematiken nicht wiederfinden, was für die Forschung die Möglichkeit eröffnet, ganz neue Fragen stellen und beantworten zu können. Archive und Bibliotheken müssen für diese Form des Wissens gleichwohl angepasste Auswahl- bzw. Relevanzkriterien definieren, neue Formate für eine forschungsadäquate Wissensspeicherung entwickeln und sich damit auseinandersetzen, wer den Zugang zu diesem Quellenmaterial regelt (Politik, Industrie, Wissenschaft?). Historiker/innen hingegen werden lernen müssen, mit diesen umfangreichen Datenbeständen methodisch sinnvoll umzugehen. Zudem soll diskutiert werden, welche Tools und kritische Methoden der Auswertung wir entwickeln müssen, wenn Social Media bzw. Hypertexte historisch analysiert und wissenschaftlich reflektiert werden sollen.

3. Neue Arbeitsweisen und die Herausforderungen der Interdisziplinarität. In Abgrenzung zum ersten Themenbereich geht es hier explizit um neue Werkzeuge und Methoden. Über welche Kompetenzen sollten bzw. müssen Forscher/innen oder Arbeitsgruppen verfügen, um sowohl die traditionelle kritische Quellenkritik als auch die für die neuen Medien erforderlichen Methoden anzuwenden? Erwünscht sind sowohl Beiträge, die aus anderen Fächern in die digitale Geschichtswissenschaft eingebrachte Arbeitsweisen thematisieren als auch solche, die sich mit Werkzeugen beschäftigen, die originär für die historische Forschung neu entwickelt worden sind. Ebenso soll diskutiert werden, inwieweit interdisziplinäre, kollaborative Arbeitsweisen aus den DH in den Geschichtswissenschaften Fuß fassen und wie die historische Arbeitsweise auf andere an DH-Projekten beteiligte Fächer zurückwirken. Sehen wir die Informationswissenschaften und Informatik als eine neue „Hilfswissenschaft“ unserer Disziplin? Und welche Rolle spielen die unter-schiedlichen disziplinären Vertreter mit ihren Zugängen bei der Anbahnung neuer Projekte in den digitalen Geschichtswissenschaften? Arbeitsberichte sind hier explizit erwünscht. Die Organisatoren behalten sich vor, parallel laufende Gesprächsrunden zu konkreten Erfahrungen und deren Implikationen anzubieten.

4. Digitale Infrastrukturen, Finanzierung und rechtliche Bedingungen. Viele Projekte leiden momentan an dem „Geburtsfehler“, dass sie aus finanziellen Gründen auf vorhandenes, also nicht explizit für die Fragestellungen eines Projektes digitalisiertes Quellenmaterial zurückgreifen müssen und kommerzielle Tools nicht breit genug anwenden können. Gleichzeitig stehen viele Projekte vor dem großen Problem der langfristigen Sicherung und Pflege digitalisierter Quellen und den daraus hervorgegangenen Forschungsergebnissen, wie sie beispielsweise in Datenbanken eingegangen und für sie aufbereitet worden sind. Wer kann Nachhaltigkeit in Speicherung und Systempflege garantieren und wie kann diese finanziert werden? Welche Folgen hat es mittel- und langfristig gesehen für die historische Forschung und die Bereitschaft der Forschenden, digital zu arbeiten und zu publizieren, wenn Digitalisate sowie Forschungsergebnisse bereits wenige Jahre nach Projektende nicht mehr zugänglich sind? Der Aspekt finanzieller und technischer Sicherung wird zum einen ergänzt durch Fragen der Qualitätskontrolle digitaler Projekte und ihrer Ergebnisse. Hierfür wäre eine Diskussion über die Ausgestaltung eines spezifischen Rezensions-/Berichtswesen wünschenswert. Zum anderen ergeben sich mit der Digitalisierung von Quellen urheberrechtliche Probleme, die ebenfalls diskutiert werden müssen. Welche Gemeinsamkeiten, aber auch welche Herausforderungen bestehen in dieser Hinsicht im internationalen Vergleich?

5. Lehre und Ausbildung der Geschichtswissenschaft im digitalen Zeitalter. Die Ausformung der digitalen Geschichtswissenschaft bedingt einen geänderten methodischen Zugang zu z.T. neuen Quellengattungen. Die universitäre Ausbildung muss hierauf dringend reagieren und ein verändertes Curriculum in den Grundwissenschaften oder ggf. neue/erweiterte Studiengänge schaffen. Entscheidend ist nicht zuletzt, dass die Digital Humanities und die traditionelle Geschichtswissenschaft die jeweilige Sprache verstehen und das jeweilige Forschungs- bzw. Erkenntnisinteresse nachvollziehen können. Ein intensiver Dialog kann aber nur entstehen, wenn es eine gemeinsame Grundlage gibt. Vorschläge für die Einbindung der Digitalen Geschichtswissenschaft in die bestehende Lehre sind gefragt. Darüber hinaus interessiert, welche Erfahrungen mit sogenannten Citizen Science-Projekten bestehen und welche man im Sinne der Best-Practice weiterentwickeln sollte.

Die Tagung wird veranstaltet vom Leibniz-Wettbewerbsprojekt „Welt der Kinder“ (koordiniert am GEI Braunschweig), dem DHI Washington/der Max Weber Stiftung (MWS), dem VHD, der F-AG Geschichte in CLARIN-D und der AG „Digitale Geschichtswissenschaft“.

Wir bitten alle Interessierten Abstracts von maximal 300 Wörtern zu formulieren und diese unter Angabe des thematischen Blocks, zu dem die eigene Präsentation möglichst zugeordnet werden soll, bis zum 15.06.2017 über easychair [https://easychair.org/conferences/?conf=digimet2017] einzureichen.

Bei technischen Problemen oder Rückfragen wenden Sie sich an das Projektteam Dr. Andreas Weiß weiss [at] gei [dot] de oder Maik Fiedler fiedler [at] gei [dot] de.

Genaure Angaben zu Tagungsort und –zeit werden frühzeitig genug öffentlich bekanntgegeben.

Zu- bzw. Absagen erfolgen in der zweiten Julihälfte.

Georg-Eckert-Institut Braunschweig (Georg-Eckert-Institut)

Deutsches Historisches Institut Washington (DHIW)

Verband der Historiker und Historikerinnen Deutschlands (VHD)

CLARIN-D Fach-AG Geschichte

AG „Digitale Geschichtswissenschaft“ im VHD

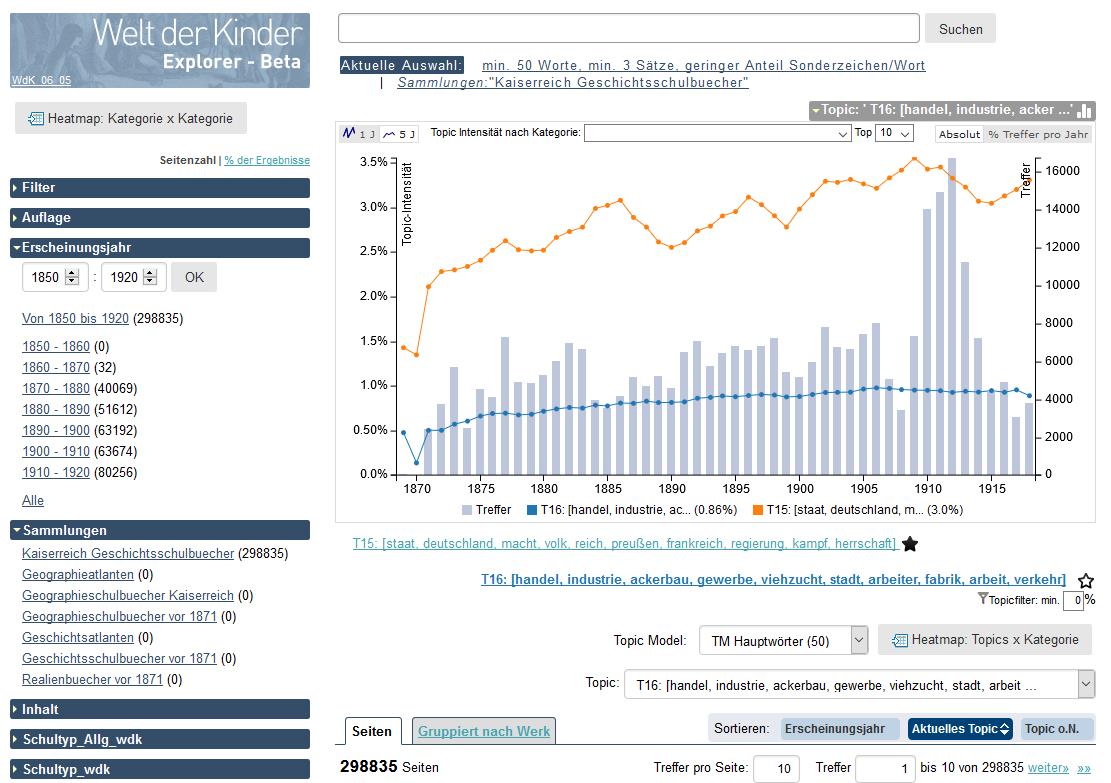

Workshop semantische Korpusanalyse: Anwendung der Tools aus dem Projekt „Welt der Kinder“

Sie wollten schon immer wissen, was sich hinter Digital Humanities wirklich verbirgt?

Dann kommen Sie zu unserem Workshop!

Hier können Sie die im Projekt „Welt der Kinder“ entwickelten DH-Tools selbst ausprobieren. Wir zeigen an einem Beispiel Möglichkeiten auf, wie man Quell-Texte exportieren und in anderen DH-Werkzeugen für weitere Detail-Analysen verwenden kann. Dies ist für alle spannend, die selbst mit großen Textmengen arbeiten wollen und nach Möglichkeiten suchen, strukturelle Muster in ihren Quellen offen zu legen, die klassisch-hermeneutisch nicht möglich wären.

Workshop-Inhalte

- Kurze Einführung in die Tools aus dem Projekt Welt der Kinder

- Anwendung der Tools auf ausgewählte Forschungsfragen in Kleingruppen: Wir helfen auch gerne dabei, eigene Fragestellungen an das Korpus zu operationalisieren

- Export von Untermengen des Korpus zur Analyse in anderen Tools: Termverteilungen & Erstellung eigener Topic Models

Interesse geweckt?

Anmeldung bei Maik Fiedler: fiedler [at] gei [dot] de

Reisestipendium benötigt?

Mail an Ben Heuwing: heuwing [at] uni-hildesheim [dot] de

| Wann: | am 21. März 2017 von 15 bis 18 Uhr |

| Wo: | Konferenzraum der Villa des Georg-Eckert-Instituts in Braunschweig: Leibniz-Institut für internationale Schulbuchforschung, Celler Straße 3, 38114 Braunschweig |

| Wer: | Dr. Ben Heuwing, Maik Fiedler |

Workshopflyer

Workshopflyer

Workshop „Argumentationsanalyse“

Am 24./25. November 2016 findet im Göttingen Centre for Digital Humanities in Göttingen ein Workshop zum Thema Argumentanalyse statt.

Dozenten sind Christian Stab und Carsten Schnober (UKP Lab, Informatik, TU Darmstadt)

Kurzbeschreibung

Link zum Programm

Workshop in Braunschweig

Vom 11-14.10.2016 fand ein Workshop am Georg-Eckert-Institut für Internationale Schulbuchforschung in Braunschweig statt.

Thema das Workshops war:

Semantic Web and Linked Open Data: motivations, solutions, models and technologies. Applications for Text Retrieval

gehalten von Armando Stellato, Universität Rom

Link zum Programm

Maik Fiedler gewinnt Reisestpiendium

Maik Fiedler gewann eines von neun Reisestipendien der diesjährigen DHd Link.

Wir gratulieren herzlich!

Impressionen Tagung „Welt der Kinder“

Endgültiges Tagungsprogramm online!

Die Welt der Kinder Weltwissen und Weltdeutung in Schul- und Kinderbüchern des 19. und frühen 20. Jahrhunderts

Internationale Tagung an der Universität Zürich vom 4. bis 6. Februar 2016

Tagungsprogramm

Link zur Tagungswebsite